Siamo nel quarto anno dal lancio di ChatGPT nel novembre 2022 ma mi sembra che sia sempre molto presente l’idea che l’AI sia una risorsa magica, immediata e, soprattutto, economica.

Troppo spesso rivedo l’atteggiamento di vent’anni fa applicato al web: l’idea che, essendo tutto virtuale, non ci siano costi reali e tutto sia semplice ed immediato.

Purtroppo invece c’è poco da fare: l’AI non è gratis, e tanto meno lo è quando si parla di contesti aziendali. Non lo è in termini puramente economici, non lo è per lo sforzo organizzativo e strutturale che richiede, non lo è culturalmente.

Ma andiamo con ordine.

IL COSTO DEL SOFTWARE E LA TOKEN ECONOMY

Ogni interrogazione, ogni elaborazione, ha un costo di consumo.

Non vale solo per la AI. Negli anni siamo passati da software scritto ad hoc a strumenti di mercato, che poi dall’installazione on premise si sono spostati sul cloud e sono diventati “as a service”.

Se già con le soluzioni a consumo del software as a service fare previsioni di spesa è difficilissimo (e i vendor hanno complicato in modo drammatico il numero di parametri e criteri che vanno a formare il prezzo) con l’intelligenza artificiale la “valuta” che è oggetto di questo costo, il token, è forse ancora più difficile da calcolare.

Soprattutto se non si sa nemmeno che questo esista.

Ho apprezzato molto un contributo di Fabio Lalli che ha parlato in maniera molto chiaro del concetto di token economy, che diventa il modo per rendere visibile fuori dalla cerchia di sviluppatori ed esperti verticali il tipo di consumo che viene fatto per le AI e le voci di spesa visibili come metrica di business.

Il primo punto, appunto, è misurare, cosa non così scontata specie se ci si muove verso il paradigma di un nuovo modello di “service-as-a-software”, un gioco di parole intelligente sull’acronimo SaaS introdotto da Scott Brinker e Frans Riemersma nel report Martech for 2025 di cui avevo parlato qui. Invece di pagare per postazioni o utilizzo di elaborazione/archiviazione, dove spetta all’acquirente utilizzare con successo quegli strumenti per ottenere i risultati desiderati, viene offerta una nuova generazione di agenti AI su base costo-per-risultato.

È quindi sicuramente utile una logica di FinOps applicata all’AI: non serve solo a “tagliare le spese“, ma a rendere il consumo una metrica di business visibile.

Il punto, infatti, non è quanto spendiamo, ma se quel costo sta producendo un vantaggio e un valore.

In azienda, un picco di spesa AI non è necessariamente un errore: potrebbe essere il segnale che qualcuno ha trovato un modo più intelligente di risolvere un problema, per cui quel consumo aggiuntivo sta producendo benefici. Molte aziende Saas e in generale le organizzazioni più mature oggi stanno cercando di monitorare in modo efficace questi temi.

Nel già citato articolo sulla token economy si presentano anche alcune metriche.

- Costo per attività, non il costo per prompt. Non si guarda alla singola attività e ai relativi token ma al processo complessivo che viene abilitato: sintesi documentale, analisi commerciale, supporto clienti, generazione di codice, assistenza interna, redazione di contenuti, ricerca.

- Costo per output valido. Come si dice nell’articolo “se dieci prompt producono una risposta utilizzabile e altri venti no, il tema non è soltanto quante chiamate sono state fatte, ma quanto costo di apprendimento o costo di iterazione viene pagato prima che il risultato sia abbastanza buono

- Costo per decisione o per tempo risparmiato. Se le decisioni sono più veloci, riduzione con errori, più informate etc. questo porta ancora più valore del tempo risparmiato (anche se è meno immediato da misurare).

- Varianza tra persone e team. Si capiscono chi sono i best performer, con l’obiettivo di trovare delle pratiche replicabili anche da altri.

Quale che siano i KPI, se l’organizzazione non li sa leggere si rischia di comprimere l’utilizzo dell’AI proprio mentre sta iniziando a generare valore, solo perché non ne capiamo il beneficio sottostante e lo vediamo solo come costo.

Il passaggio cruciale, come ho già scritto in passato, è dall’ingegneria del software all’ingegneria del valore. La tecnologia deve essere uno stimolo al cambiamento, ma il cambiamento va fatto dalle persone e l’AI non può creare coraggio o idee chiare dal nulla.

In questo però c’è però un altro costo da valutare, quello necessario a mettere in ordine le proprie fondamenta.

IL COSTO DI METTERE A POSTO LE PROPRIE FONDAMENTA (PER NON AVERLO FATTO PRIMA)

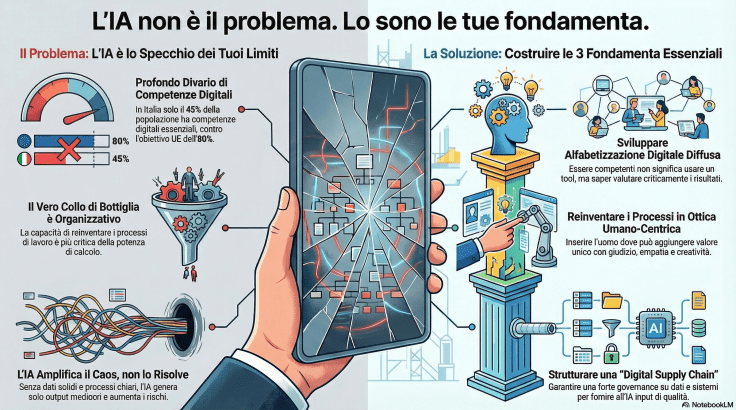

Come scrivevo già a fine anno scorso, l’AI non è il vostro problema: lo sono le vostre fondamenta.

Il tema non è tecnologico, ma organizzativo e culturale, la tecnologia generativa è uno specchio spietato che riflette tutti i limiti interni che le aziende hanno ignorato per vent’anni,a mano a mano che si stratificavano le altre innovazioni digitali.

Il vero collo di bottiglia dell’intelligenza artificiale è la reinvenzione organizzativa, non la potenza di calcolo, come scrive Forrester Research in questo post, che si parla davvero bene con quanto ho pubblicato anche qui sul blog, il ROI dell’IA dipende quasi interamente da qualcosa in cui non si investe: la capacità di ripensare il modo in cui si lavora.

Per troppo tempo, l’organizzazione aziendale è stata “la madre di tutti i problemi di governance della tecnologia” come ho scritto per anni, limitando la reale potenza degli strumenti, che senza l’adozione da parte delle persone sono degli oggetti inutili.

Nella pratica dell’utilizzo della Gen AI c’è un chiaro segnale organizzativo. Nel tempo abbiamo costruito aziende basate su specializzazioni verticali e silos impermeabili. L’AI richiede invece team interdisciplinari dove il valore si sposta dalla pura esecuzione specialistica alla capacità di integrare discipline diverse. Non significa che le competenze si equivalgono, ma che l’AI potenzia chi sa già fare una cosa, a patto che l’organizzazione gli permetta di muoversi in modo fluido.

Sempre più i nuovi tool vanno in questa direzione, pensiamo ad esempio all’ultimo nato di casa Anthropic, Claude Design. E proprio questa nuova soluzione mi offre un elemento di riflessione che ci porta ad un altro dei temi collegati.

La pagina introduttiva di Claude Design fa una premessa quasi subito: “questa guida presuppone che il sistema di design della tua organizzazione sia già stato configurato, quindi tutto ciò che crei utilizzerà automaticamente i colori, la tipografia e i modelli di componenti del tuo marchio”.

Ossia tradotto, questo oggetto funziona bene se avete delle basi solide, di cui abbiamo appena parlato, ma anche una conoscenza ben codificata, che è il prossimo punto che vorrei trattare.

LA GESTIONE DELLA CONOSCENZA

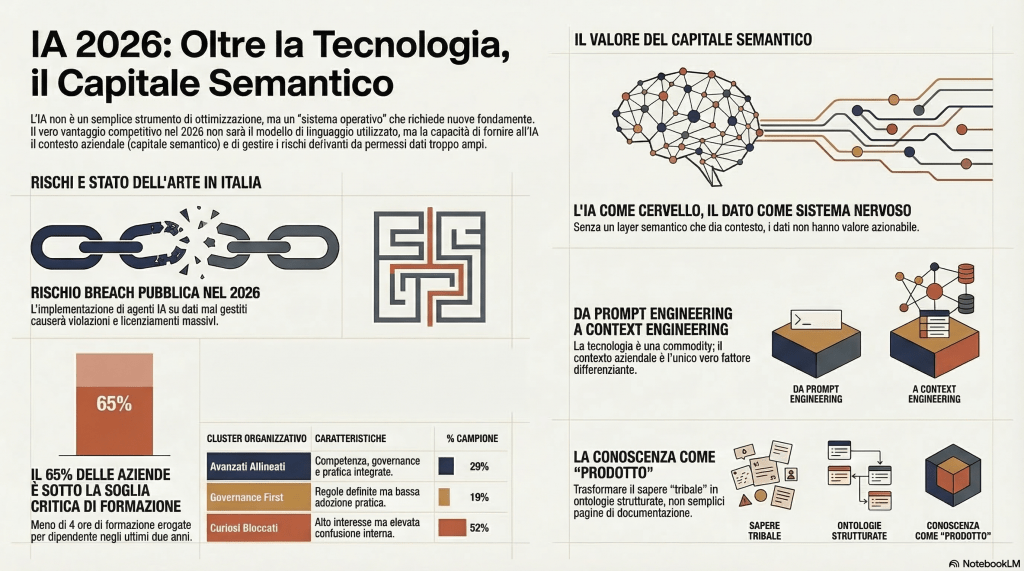

Per rendere l’AI davvero efficace serve un layer semantico. Non basta più il prompt engineering (saper chiedere bene) ma serve il context engineering, ossia la capacità di rendere esplicita la conoscenza che un’organizzazione ha accumulato nel tempo e che di solito vive solo nella testa delle persone.

Qualsiasi azienda nel tempo ha costruito delle classificazioni concettuali dei propri prodotti, dei propri clienti, dei propri processi. Molte di queste distinzioni non stanno in nessun documento ufficiale, la sanno fare bene solo i dipendenti senior. Quando si introduce un agente AI per supportare le vendite, quella conoscenza tacita diventa il vero collo di bottiglia: il modello può essere potentissimo, ma se non sa cosa significa “cliente strategico” per quell’azienda specifica, produce output generici e inutili.

Questo è il lavoro che non si vede e che spesso non si vuole fare: mappare la “conoscenza tribale” dell’organizzazione e trasformarla in qualcosa di strutturato, ontologie, grafi di relazione, vocabolari condivisi. Non è un compito solo per l’IT: sapere “cosa è un cliente” o come si classifica un’opportunità commerciale è responsabilità del Business a 360 gradi.

L’architettura informativa, inoltre, non è statica: deve essere continuamente aggiornata, il che richiede collaborazione costante tra tutte le funzioni. La causa più frequente dei fallimenti dei progetti AI non è tecnologica: la conoscenza è tacita, frammentata, rinchiusa in silos. Gli esseri umani fanno riunioni per allinearsi; gli agenti AI, senza una guida semantica, bruciano solo token.

La sfida è trasformare la conoscenza da una serie di documenti sparsi a un vero e proprio prodotto aziendale. Si tratta di un passaggio in più rispetto alla “sola” gestione del dato: l’ontologia tagga, correla, contestualizza. Per approfondire, vale la pena leggere questo post sul funzionamento del software Palantir, che su queste logiche ha costruito il suo modello di business.

Inutile dirlo: anche questo non è uno sforzo banale, e non è certo gratuito.

MA ALLORA, LA AI FA CRESCERE I COSTI, INVECE CHE RIDURLI?

Quindi: l’AI fa crescere i costi, invece che ridurli?

No. Ma li rende visibili per la prima volta.

Molto di quello che oggi sembra un costo nuovo è in realtà il conto che arriva da decisioni non prese, o rimandate, negli ultimi vent’anni. Dati mai puliti, processi mai documentati, conoscenza mai codificata, organizzazioni mai ripensate. L’AI non ha creato questi problemi: li ha portati in superficie, e ha messo un prezzo su ciò che prima sembrava semplicemente “come funzionano le cose qui”.

Questo è scomodo. Ma è anche un’opportunità.

La vera differenziazione non verrà dal modello di linguaggio che userete, quello sarà probabilmente lo stesso dei vostri competitor. Verrà dalla profondità del contesto che saprete costruire intorno a quel modello: la vostra storia, le vostre sfumature, il modo in cui saprete “cablare” la vostra unicità all’interno dei sistemi artificiali. Chi fa questo lavoro adesso, mentre la maggior parte delle aziende è ancora ferma alla fase sperimentale, costruisce un vantaggio che sarà molto difficile da colmare dopo.

La buona notizia è che non si parte da zero: l’AI stessa può essere un alleato in questo consolidamento. Può aiutare a documentare processi che esistono solo nella testa di chi li esegue, a estrarre pattern da dati dispersi, a rendere esplicito ciò che è sempre rimasto implicito. Ma solo se si decide di usarla con questa intenzione, non come scorciatoia, ma come strumento per costruire basi più solide.

Il costo, alla fine, non è nell’usare l’AI. È nel continuare a non capire cosa si sta usando, e perché.

English version is available on https://medium.com/gianluigizarantonello/ai-isnt-free-and-the-highest-cost-isn-t-what-you-think-0e20c53360f9

Lascia un commento